AIは間違うのになぜ使うのか

「ChatGPTの回答は必ずしも正しいとは限りません。重要な情報は確認するようにしてください」。

ChatGPの入力欄の下には、そう書かれている。Claudeにも、Geminiにも、同じような注意書きが掲げられている。最新モデルであるGPT-5.2 Thinkingは「GPT‑5.1 Thinking と比べてハルシネーションの発生が少なくなっています」といい、少なくとも1つのエラーを含む応答は8.8%から6.2%に減少したらしい。これを高いと見るか低いと見るかは人によるだろうが、結果が間違うことを明示しながら料金を取るサービスというのもなかなか珍しい。なぜ僕らは堂々と嘘を吐くAIに課金しているのだろうか。

実のところ、多くの人は「正解」を求めてAIを使っているわけではない。無料プランで十分だと考えている人も多いし、前回の記事でも書いた通り一部のユーザーは、AIに「話し相手」としての価値を見出している。業務においては、メール作成やイベントの段取りなど、型が決まっているものの再生産を時短するために使われることもあるだろうけど、その程度であれば間違いがあっても手作業で直せる。

つまり、僕らは最初から正解のないことや、ほぼ正解はあるものの完全コピペは難しいものをAIに任せている。正確な答えが必要なら、検索エンジンや社内データベースで裏を取ることになる。僕らがAIに期待しているのは、むしろ「考えるための相手」なのではないだろうか。

AIで「効率化」を目指す学生たち

AIは「考えるための補助」としては大いに役立つ。これは多くの人が実感するところだろう。とはいえ、大学においては「考える」のではなく、「思考をAI任せにする学生たち」という課題が浮上している。レポートの課題文をそのまま投げて、存在しない参考文献を挙げて提出してくるという低レベルなものは、さすがにすぐ落とされるので目立たなくなったけれど、その分だけ問題はより本質的なことに迫ってきている。

目立つパターンとしては「授業を受けずに資料をAIに要約させて内容を把握する」という「効率化」(!)や、「授業コメントやレポートに書くべき論点を聞く」といった「間違いを減らす」ための使い方だ。これは同じように使っている社会人も多いし、なんなら「効率的」「合理的」と褒められる可能性すらあるわけで、「結果が同じなら時短できた方がいい」というタイパ時代にはなかなか責めづらいところもある。

実際、日本経済新聞の記事によると、全国の6割の大学が生成AIを教育に活用しており、その目的としてもっとも多いのは「授業実施に必要な情報の収集」という、教員側の活用だという。それは「AIを使って調べる」という学生の行動とどこが違うのか。

一方で同記事では、4割以上の大学が「学生の思考力や創造性が損なわれる」ことを懸念していると伝えられている。現場の実感としては、この懸念の捉え方には注意が必要だ。「何も考えずにAI任せにする」学生は、AIがなかった時代からずっと、できるだけ授業へのコミットを減らしたいと考えてきたし、「ワンチャン」で単位が出ればいいと考えているので、教育効果という点では以前と変わらない。

高度な回答に振り回される

むしろ問題なのは、「安易に答えを求めた結果、高度な回答を示されて戸惑う」ケースだ。

僕の授業では、アンケートデータの解析については基礎的なことだけを教えていて、多変量解析については扱っていない。それにも関わらず、ある学生が「どうやら重回帰分析というのが妥当らしいです」とAIの回答を真に受けて相談してきた。データを見せてもらうと、そもそも重回帰分析を適用する前提で設計された調査ではなく、分析そのものは行えるとしても、研究上の解を得るには不適切なものだった。

これは極端な例かもしれないが、レポート全体を見渡すと、似たような問題が散見される。AIに相談した結果、それ自体は大きな間違いではないが、優等生的な模範解答が並ぶ。「じゃあ、それを実現する上でハードルとなることはどうやって乗り越えるの?」と言いたくなるような回答ばかりなのだ。

この問題は、大学に限った話ではない。ロート製薬は2025年12月、新卒採用のエントリーシート活用をやめ、対面での面接に切り替えると発表した。理由は「生成AIによって内容が均質化した」からだという。AIを使うこと自体は悪くない。しかし、AIが生成した「正しそうな答え」をそのまま使った結果、誰もが同じような回答をするようになったのだ。

早い段階から勉強のパートナーとして使うのではなく、効率的に回答を求めた結果、身の丈に合わない答えを示され、「AIの回答が難しすぎて何を言っているのか分からない」という状態になる。それならばと自分でも納得のいく答えを選ぶと、多くの人が平均的な回答に収束する。これが、相対的に真面目な学生に生じている問題なのだ。

身の丈に合った答えを引き出すために

「学生の思考力が損なわれる」というのは、僕の見立てでは「自分の拙い考えより、AIの答えの方が正しそう(単位が取れそう)に見える」という、ある種の諦念から生まれている。

こうした問題を避けるには「自分の身の丈に合った答えを引き出し、自分の回答の質を高める」ためのAI活用が欠かせない。たとえば早くから「中学生でも分かるように説明してください」といったプロンプトが知られていたが、これは「学習段階」という単純な指標で自分の知識を測るものなので、常に役立つとは限らない。

というより学生にとって必要なのは「中学生でも分かるように説明してもらうことで、大学生が理解するべきことを理解し、その水準でレポートを書く」ことなのだから、説明だけ易しくしても意味がないのだ。これから学習するべきことを効果的に学ぶために必要なのは、いわゆる「無知の知」、すなわち「自分が何を知らず、何を知りたいと思っているかを知る」ことなのだ。

AIとの壁打ちを効果的にする「6つの目的」

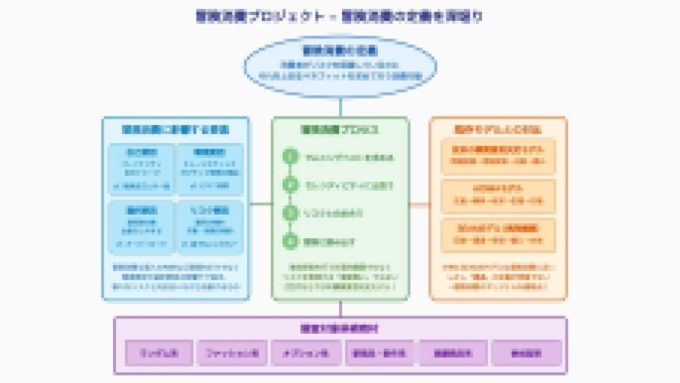

こうしたことを自覚するために僕が実践し、また指導しているのは「AIを使って壁打ちをする際に、『目的』を明確にする」ことだ。具体的には、以下の6つをはっきりさせてから、あるいは明確にするために壁打ちをするのである。

- テーマ: 何について考えるのか

- 理由: なぜ考えたいと思っているのか

- 現状: いまどこまで分かっているのか

- 不明点: どのようなことが分からないのか

- 指示: AIに何をしてほしいのか

- 目標: どうなったら私は満足なのか

これらの「目的の言葉」は、要するに現状と目標に関する深い自己理解を求めるものだ。もちろん大抵の場合、これが分からないからAIに聞いているというのが普通なので、「壁打ち」というのも、自分が何を分からないかを分かるために行われる。

実際の対話を見てみよう。以下は、雑なプロンプトと、6つの目的を意識したプロンプトの比較だ。

雑なプロンプト:

新作のコンビニスイーツのプロモーション方法を教えて。対話型プロンプト:

大学の講義「消費者の心理と行動」に基づき、新作コンビニスイーツの

プロモーション方法を考えたいです。

まず、私の考えている方向性です:

・講義で扱った概念:説得効果(発信源効果とメッセージ効果)、

精緻化見込みモデル、インストア・マーチャンダイジング

・ターゲット:大学生、特に甘いものをSNSで共有したい層

・訴求ポイント:罪悪感の少なさ、写真映え、ストレス解消

これを深めるために次のステップで進めたいです。

1. 私の方向性の整理と不足視点の指摘

2. 私に3つ質問して、回答を引き出す

3. その回答をもとに、3つの施策案と根拠を提示

4. 最後に、企画の構造(ターゲット・心理・施策)を図式化

まず1番の方向性の整理をお願いします。雑なプロンプトに対しては、AIは一般的な「SNS映えと話題性の創出」「プレミアム感の強調」といった、どこかで見たような提案を並べてくる。それは間違いではないが、自分の考えを深めるものではないし、没個性的で、「とりあえず提出しました」というアイディアにしかならない。

一方、対話型プロンプトでは、AIは「方向性の整理と評価」「不足視点の指摘」を行い、さらに「ターゲットの情報処理経路の明確化」「競合との差別化視点」「購買直前の行動を促す視点」といった、より具体的な問いを投げかけてくる。これによって、自分が何を知らず、何を考えるべきかが明確になるのだ。

壁打ち記録をコンテキストにする

さらにこうした「考えを深めるための対話」を効果的にするために僕が実践しているのは、対話の記録をコンテキストとして次の対話に持ち込むことだ。

2025年の前半によくやっていたのは、zoomで録画した会議や講義の記録をClaudeでSVG化して要約するという作業だった。zoomが文字起こししたテキストファイルをそのままClaudeに添付して、「SVGとしてまとめて」と投げると、要点がスライドとして生成される。ビジュアル要素は低いが、マークダウンの文章で読むよりは一覧性が高く、重宝していた。

これはいまならNotebookLMで行えるようになったけれど、ここで気づきになったのは、「AIと考えた内容」を次の対話のコンテキストとして用いることで、継続的な思考の深掘りが可能になるということだった。

AIサービスの多くはそれまでの会話を学習するオプションを提供しているし、「プロジェクト」のような形で学習する範囲を絞ることもできるけれど、どのような知識を参照してくるかまではコントロールできない。そこで対話の記録と思考の経緯をコンテキストとして提供することで、いわば「続きを考える」ことができるようになる。

この「思考の記録を要約して学習資源として使う」という作業は、今年の後半に実践した「AIを用いた執筆支援」や「日次・月次のタスクレビュー」へと展開するのだが、その話はまた次回以降の記事で。

正解を探すことの重要性

冒頭に戻ろう。なぜ僕らは、間違うAIに金を払っているのか。それは、AIが「正解を教えてくれる」からではなく、「正解を探すプロセスを支援してくれる」からではないだろうか。

よく「AIの答えを鵜呑みにしてはいけない」という。ではどうすればいいのか。重要なのは、AIが示す答えを起点に自分の考えを深めることだ。6つの目的を明確にし、対話を記録し、そのコンテキストを次の思考に活かす。こうした実践を通じて、僕らはAIという「壁打ち相手」を、本当の意味で自分の思考のパートナーにできるのだ。

AIは間違う。しかし、自分が何を考え、何を望んでいるかを探るプロセスにおいては、AIは嘘を吐かない。なぜなら、その答えは自分の中にしかないからだ。AIはただ、その答えを引き出すための鏡なのだ。